https://www.nature.com/articles/s41592-024-02353-z

文章首先介绍了单细胞组学的发展,它为我们提供了研究细胞特性的前所未有的资源,包括细胞类型、状态以及它们在发育、疾病发生和治疗反应中的变化。尽管有大量的数据集,但目前的单细胞模型还无法充分利用其中的信息。

文章接着讨论了变换器架构,这是一种在其他领域因能够处理大规模、异构数据集而成为基础模型首选的深度学习模型。作者探讨了变换器是否也能在单细胞建模领域引发类似的转变。文章描述了变换器架构及其在单细胞数据上的适应性,并全面回顾了变换器在单细胞分析中的现有应用,批判性地讨论了它们在未来单细胞生物学中的潜力。

文章还讨论了单细胞数据的表示方法,包括如何将非序列化的单细胞组学数据转换为适合变换器输入的格式。介绍了变换器架构的不同部分,以及最近提出的针对单细胞数据的特定适应性。此外,文章还讨论了变换器在单细胞数据上的应用,包括细胞注释、细胞和基因表示学习,以及单细胞模态预测等任务。

文章指出,尽管变换器在单细胞组学中的应用前景广阔,但该领域目前还面临一些限制,包括数据的噪声、批次效应和稀疏性等问题。作者通过研究这些限制和技术挑战,旨在为机器学习和单细胞生物学交叉领域的未来研究方向提供结构化的展望。

文章最后总结了变换器在单细胞组学中的潜力,并对未来的研究方向提出了展望,包括构建一个多模态的基础模型来全面理解细胞变异性,以及在考虑扰动数据时对细胞状态进行建模。作者强调,尽管变换器在其他领域的成功应用,但在单细胞组学中应用变换器还需要进一步的评估和研究。

一、引言

单细胞组学的兴起加深了我们对生物系统的理解,为我们提供了细胞异质性和动态性的细致视角。

这包括对细胞类型、细胞状态及其在发育、疾病发作和治疗效果响应过程中的新见解1-3。生成的数据量大且异质性高,既带来了机遇也提出了挑战。当前的分析方法无法捕捉跨多样本大规模单细胞数据集中的变异性,这促使了新型计算策略的开发。

与此同时,机器学习领域见证了变换器(transformers)的显著影响,变换器最初是为自然语言处理(NLP)任务设计的,近期已被用作跨领域基础模型的支柱4-6。基础模型是一种在广泛数据上通过自监督训练的机器学习模型,该模型能有效适应广泛的下游任务,通常仅需极少量的额外训练6。

基于变换器的基础模型已成功应用于众多领域,包括计算机视觉7、语音处理8、时间序列分析9,以及在基因组学10和蛋白质组学11,12中的分类值序列建模。变换器利用大规模、异质数据集的能力,以及在跨领域众多任务中的泛化能力,使其成为单细胞组学分析潜在的变革者(图1)。

然而,所有这些领域的数据都具有一个显著特点,即在原始单细胞组学数据中不存在的序列性,这带来了独特的挑战。

二、变换器架构概述

深度学习在单细胞生物学中的应用已十分广泛13–16。

大多数深度学习模型将输入视为一个向量,并迭代地应用一系列可学习的层,其中每一层通常由一个线性变换后接一个逐元素的非线性变换组成。

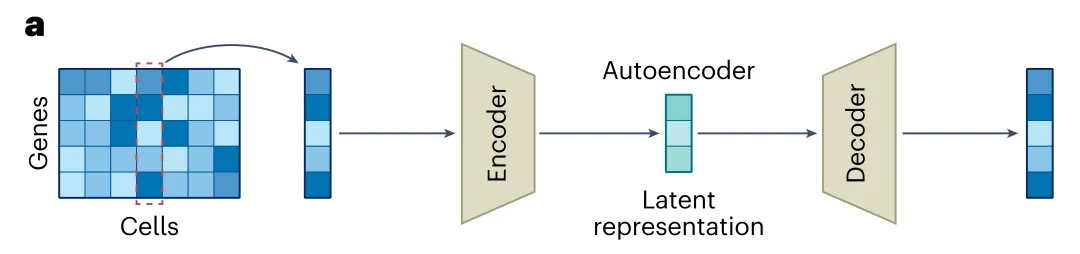

在单细胞基因组学的背景下,输入向量可能代表一个细胞,向量中的各个分量对应单个基因的RNA表达。在单细胞应用中,常见的模型架构是自编码器,因为它不依赖于难以获取的数据标注。如图2a所示,自编码器由编码器和解码器组成,训练目标是将输入映射到一个低维潜在表示,该表示构成一个瓶颈,解码器试图从该瓶颈中忠实地重建输入。

image-20241011111035128

在单细胞RNA计数上训练的自编码器可用于降低细胞转录组轮廓的维度。由于自编码器学习的是一组固定的参数,这些参数用于所有输入(即所有细胞),瓶颈迫使模型学习特征提取器,以捕捉全局最相关的模式,同时过滤噪声,最终得到有意义的细胞变异潜在表示。

变换器架构,如图2所示,是一种使用自注意力机制处理表示为嵌入集的输入数据的深度学习模型。

它借鉴了自编码器的一些理念,但在本质上也与之有所不同。例如,与自编码器类似,最初提出的变换器包含编码器和解码器,也可以在不需要数据标注的情况下进行训练。然而,两种架构之间存在重要的差异。

首先,与自编码器不同,变换器通过注意力机制根据数据样本中的所有其他输入特征调整对特定输入特征的处理方式5。例如,这允许变换器灵活地考虑不同细胞类型当前处理的不同基因交互模式。

其次,变换器将每个输入样本视为一组嵌入,这需要在将细胞转录组轮廓传递给变换器之前将其嵌入到这种格式。例如,一个细胞可以由一组基因嵌入表示,这些嵌入捕获它们各自的RNA计数。

第三,变换器中的编码器和解码器组件在功能和设计上与自编码器中的对应组件不同。自编码器中的编码器将输入映射到瓶颈潜在空间,从而执行降维(图2a),而变换器中编码器产生的表示不受瓶颈的限制(图2b)。

image-20241011111324868

与自编码器的对应部分不同,变换器解码器处理变换器编码器的输出,并逐个元素地生成一个序列。变换器编码器和解码器通常独立使用,仅编码器模型常用于为每个基因生成上下文化的输入嵌入。这样的嵌入捕获了给定基因的性质及其在给定细胞中的表达水平,同时考虑了其他基因的表达,这为解决基因级别的任务打开了可能性,例如在特定细胞中进行基因剂量敏感性预测17。

仅解码器模型以及编码器-解码器变换器用于序列生成,例如,转录组细胞轮廓模拟,但这需要将RNA计数表示为一个序列。与常用的单细胞模型相比,这些显著差异强调了深入描述单细胞变换器的必要性。

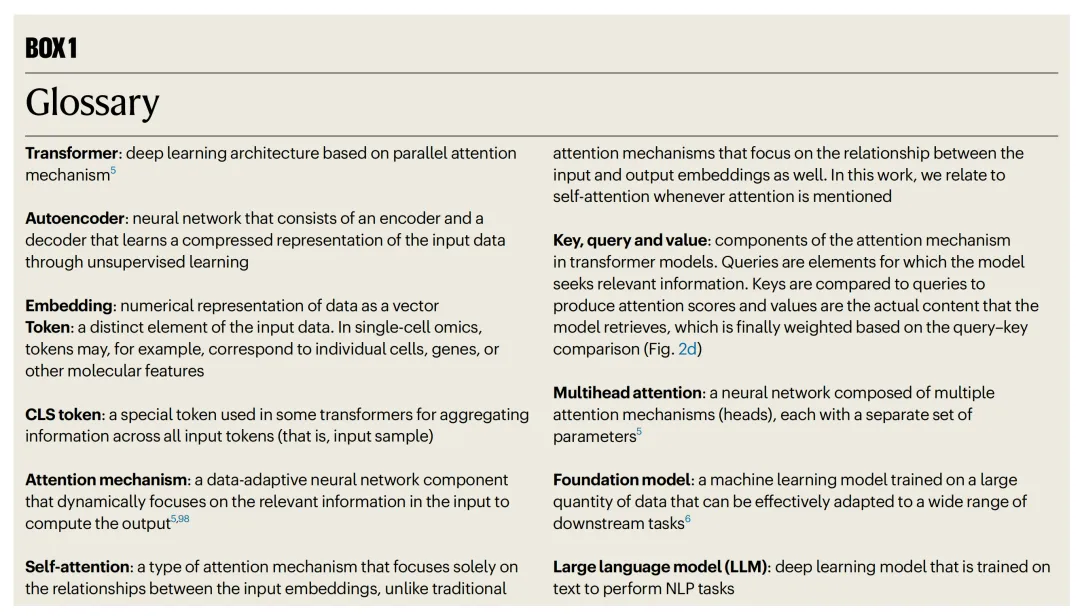

在本节中,我们回顾了变换器架构的各个部分以及最近提出的针对单细胞的特定适应。有关术语的词汇表,请参见框1。

image-20241011111547190

三、单细胞输入数据的表示

变换器在处理序列数据方面具有显著影响,它们最初就是为了这种数据而设计的5,如自然语言18、DNA10或蛋白质序列19。然而,非序列化的单细胞组学数据提出了挑战,因为这要求将数据嵌入到适合变换器的格式中。

变换器将每个输入样本视为由嵌入xi组成的集合S。样本间的嵌入数量可以变化。在单细胞数据中,输入集合S可能表示组织或捐献者内的细胞集合,其中xi代表单个细胞。或者,S可以对应单个细胞,xi代表单个基因的属性,如RNA计数。

这类似于自然语言处理中的分词,其中文本被分割成称为“标记”的子词单元,每个唯一的子词都有一个对应的嵌入,该嵌入在训练过程中学习得到。变换器对输入嵌入的顺序是不变的,这促使了“位置编码”的使用,位置编码被添加到标记嵌入中以指示标记在输入中的位置。

xi定义为标记嵌入和相同维度的位置编码的元素-wise和5。位置编码可以通过固定公式计算,也可以像标记嵌入一样学习得到。这种编码已在许多变换器应用领域中使用,包括自然语言5、计算机视觉7和时间序列分析9。

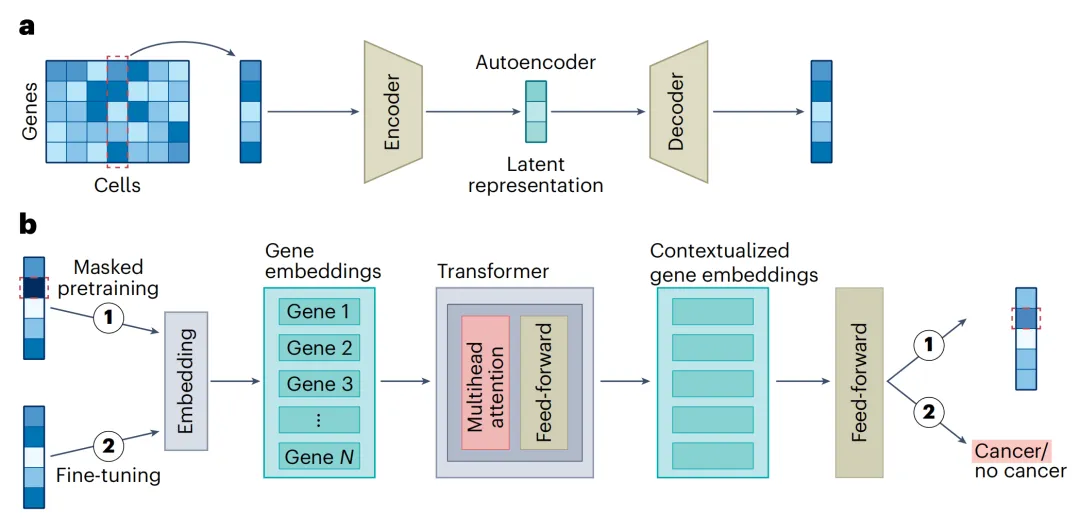

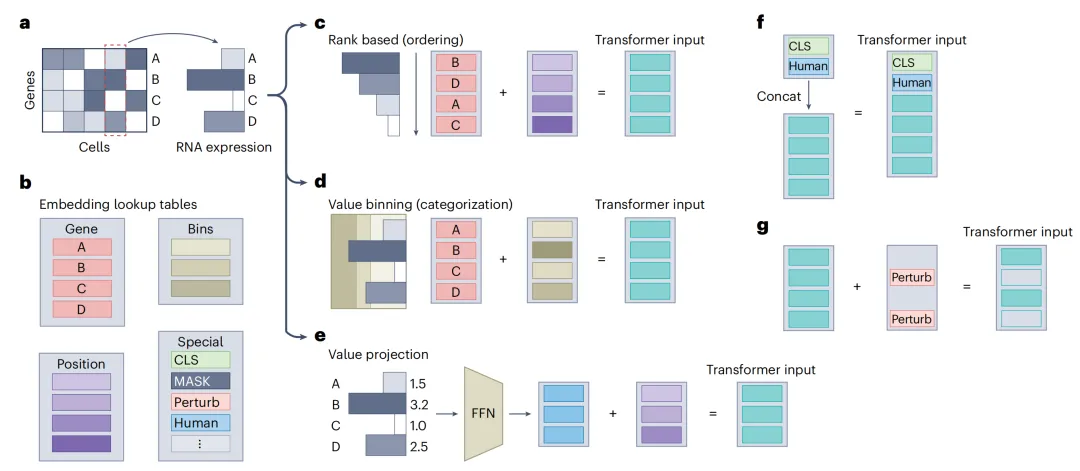

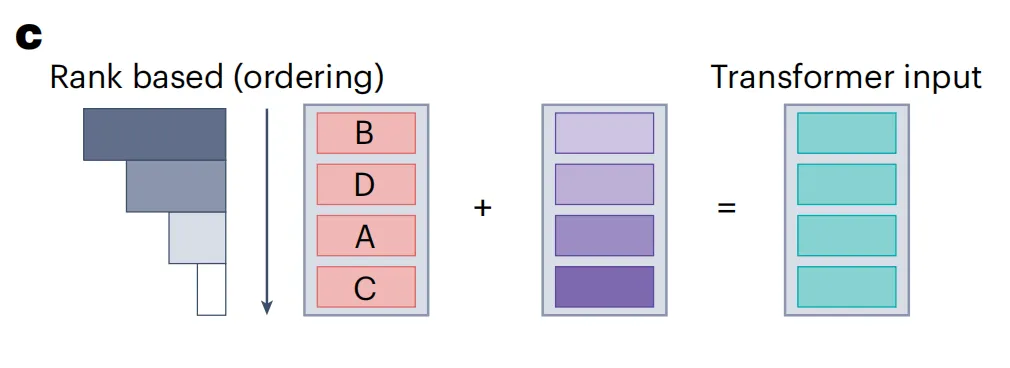

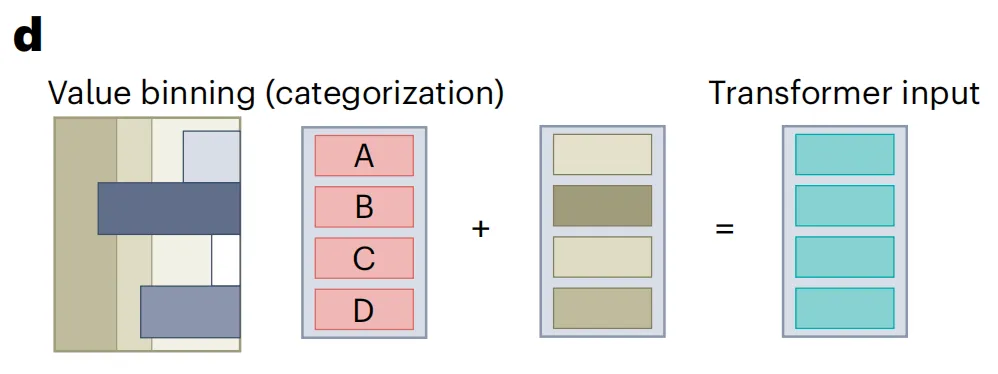

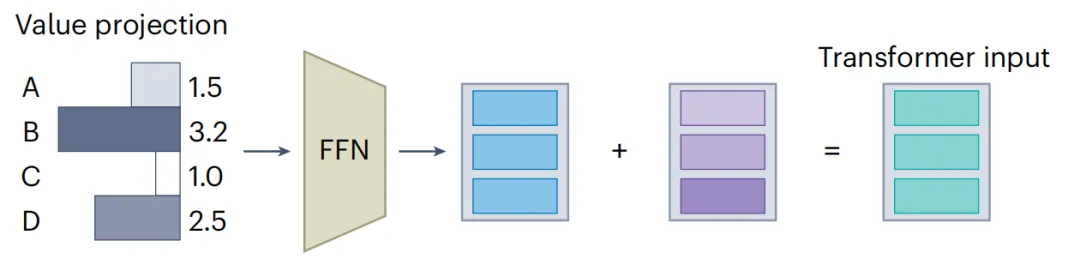

值得注意的是,现有的单细胞变换器主要在将单细胞组学数据转换为适合变换器输入的方法上存在差异。最常用的方法可以分为三个主要类别(图3),如下所述。

图3分析了将单个细胞的基因表达转换为变换器可使用格式的三种常见方法。

image-20241011111626542

a-e部分展示了从单个细胞的RNA计数(a)转换为变换器输入格式的过程,每种方法都使用了可以存储在查找表(b)中的额外嵌入。这些嵌入通常在模型训练过程中学习。所有三种方法都通过不同嵌入的元素-wise求和来获得变换器输入嵌入。

常见的处理方法包括:

● 基因嵌入和位置编码,其中顺序由标准化RNA读数确定(c);

● 基因嵌入和对应每个基因表达水平的bin的嵌入(d);

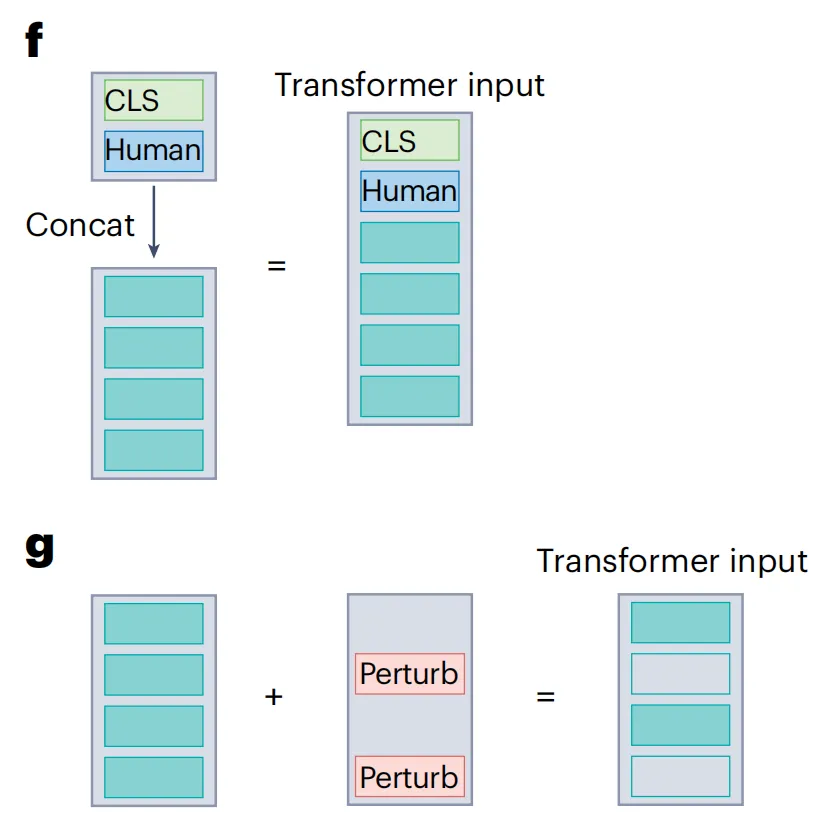

● 通过基因表达值和位置编码或基因嵌入的投影获得的嵌入(e)。f,g部分说明了某些模型定义特殊标记以编码附加信息的方法。

● f部分,一个特殊标记,通常命名为CLS,可用于细胞(样本)表示。这种样本级别的标记构成了额外的变换器输入嵌入,它们与输入嵌入连接(表示为“concat”)。

● g部分,通常也会将某些特殊标记嵌入添加到输入嵌入中,类似于位置编码,以编码附加的基因(标记)级别信息。例如,这样的标记可能指示基因扰动(表示为“perturb”)。

综上所述,这些方法展示了如何将单细胞的RNA计数数据转换为变换器可以处理的嵌入表示,同时通过特殊标记的引入,增强了模型对细胞和基因层面信息的编码能力。

为简化起见,我们假设输入样本S捕获了细胞的转录组轮廓。请注意,其他组学模式也已以类似方式进行了解析20。

3-1:排序

数据被表示为类似于自然语言输入的标记序列,这允许直接重用经过充分研究的NLP变换器方法。

例如,在iSEEEK21、Geneformer17和tGPT22中,每个基因都是一个标记,具有相应的可学习嵌入,基因标记的顺序通过细胞内的标准化表达水平进行排序(图3c)。

image-20241011112138010

位置编码被添加到标记嵌入中,就像在NLP中一样。这种方法降低了数据分辨率,导致了信息丢失23。

3-2:值分类

每个基因由一个嵌入表示,其每个细胞的RNA计数经历值分箱(图3d)。

image-20241011112200963

分箱允许我们即使原始输入是连续的,也使用为分类数据设计的方法。与排序类似,它降低了数据分辨率。在值分箱中,我们定义连续的值区间。每个值区间都有一个对应的嵌入,xi是基因嵌入和值箱嵌入的和20,24。区间可以大小相等,如在单细胞变换器scBERT24中,或者大小自适应,如在scGPT20中。

在后一种情况下,每个区间代表单个细胞中所有表达基因的相等部分。这种自适应大小的箱子保持了跨测序批次的意义,因为细胞中的最高表达总是对应于最高表达箱。

此外,scBERT24的等大小箱子在某些情况下导致几乎所有值落入单个箱子,大大降低了数据分辨率。

3-3:值投影

另一种方法使用输入数据的投影。在输入数据对应于作为基因表达值向量的细胞转录组轮廓的情况下,xi是两个部分的和:基因表达向量的投影和一个位置或基因嵌入,其中投影通常是线性的25(图3e)。

image-20241011112254837

这种解决方案相对于排序和值分类的优势在于它不一定降低数据分辨率。然而,它产生了连续嵌入,这与成功的NLP变换器不同,并且它对模型性能的影响尚不清楚。变换器输入嵌入的数量可能对应也可能不对应于输入数据中的基因数量。输出嵌入的数量可能对应于所选基因通路的数量,如在模型TOSICA25中,这种选择是为了增强模型的可解释性。

此外,变换器可以通过特殊标记引入额外的信息层。这些标记可能代表应用于给定细胞或基因的扰动20,26、物种信息26、数据批次或数据模式20。

特殊标记嵌入要么添加到单个输入嵌入xi中,用于标记级信息(图3f),要么添加到输入集合S中,用于样本级信息(图3g)。特殊标记嵌入通常是可学习的,类似于基因或位置标记嵌入。

image-20241011112327430

在S代表组织内细胞集合而xi表示单个细胞的情况下,xi可以建模为位置编码和细胞表达轮廓嵌入的和。位置编码来源于细胞的空间坐标,反映了细胞在组织结构中的位置。细胞的表达轮廓嵌入可以计算为可学习基因嵌入的和,每个基因嵌入根据细胞中基因的表达水平进行加权。这种表示允许建模细胞-细胞关系,但限制了分析单个基因相互作用的能力27。

鉴于单细胞变换器是最近才引入的,对非序列化组学数据编码方法影响的研究很少。我们预计一旦确立了最佳实践,该领域将就此达成共识。

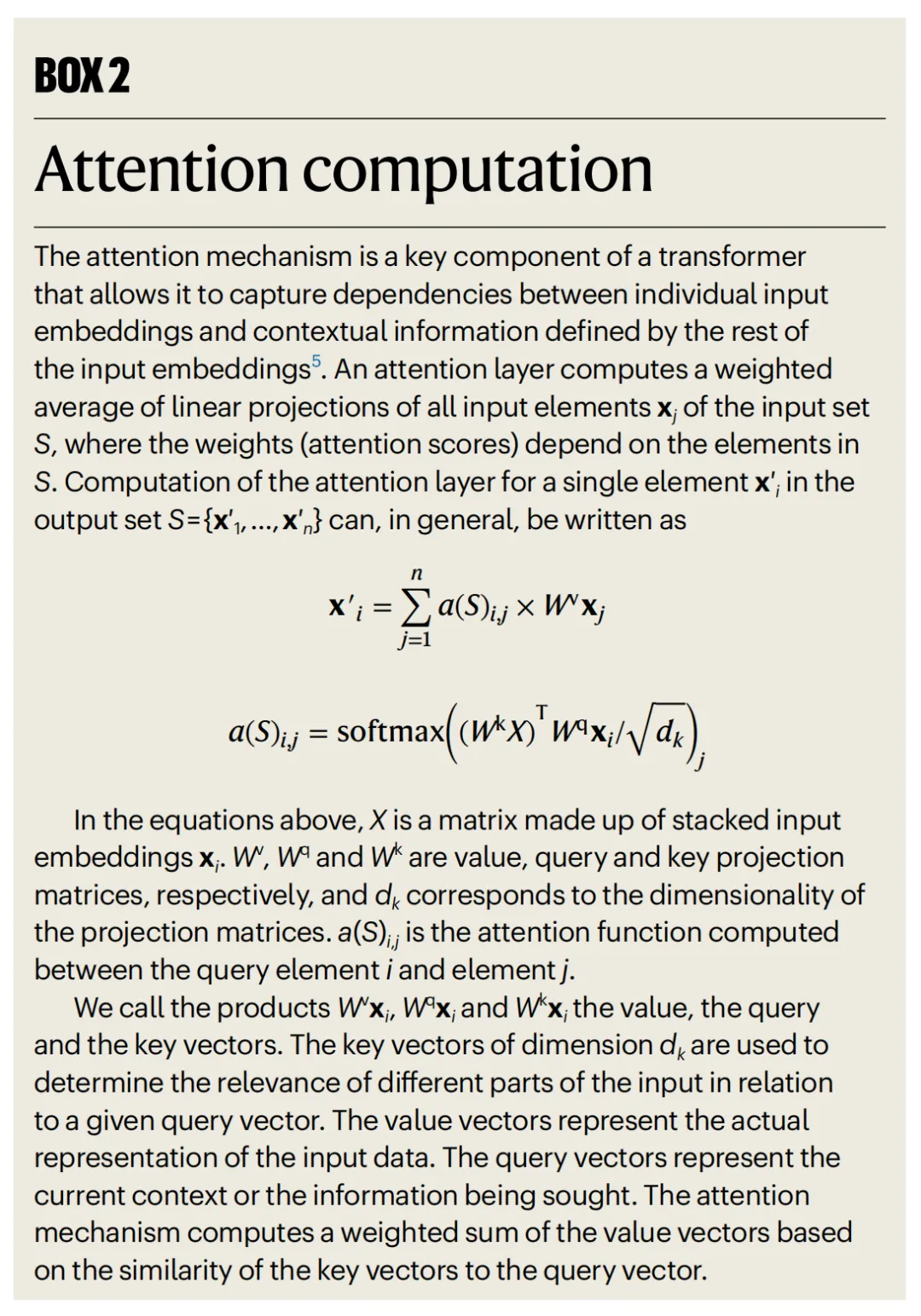

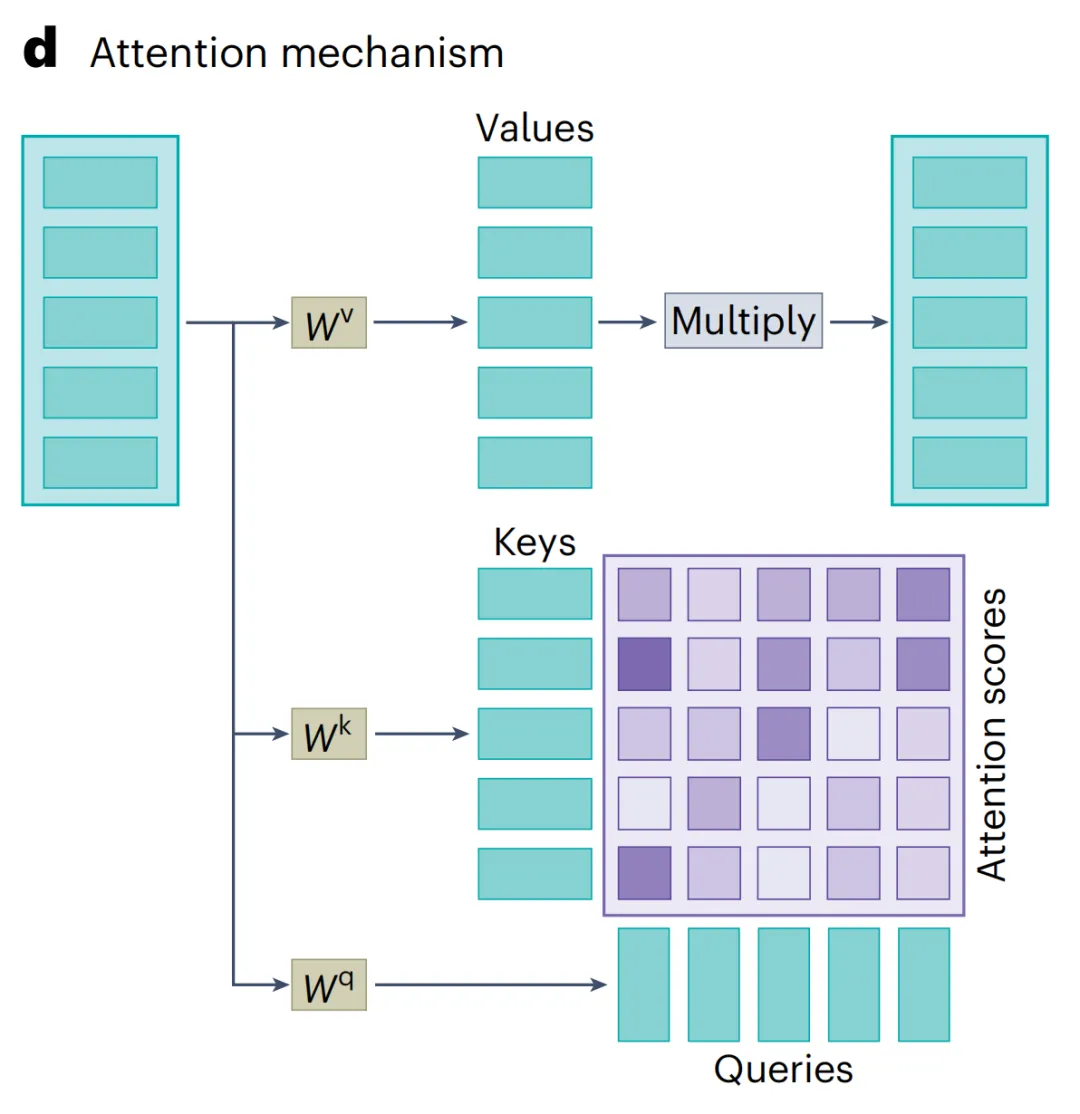

四、基因与细胞注意力

变换器层由两个连续层组成,一个注意力层通过“关注”S中的其他元素来转换每个元素xi,随后是一个传统的前馈网络(FFN),它单独处理元素xi。注意力机制是变换器的一个关键组件,它允许变换器捕获输入嵌入之间的依赖关系,并生成上下文化嵌入5。

关于注意力计算的细节,见框2。

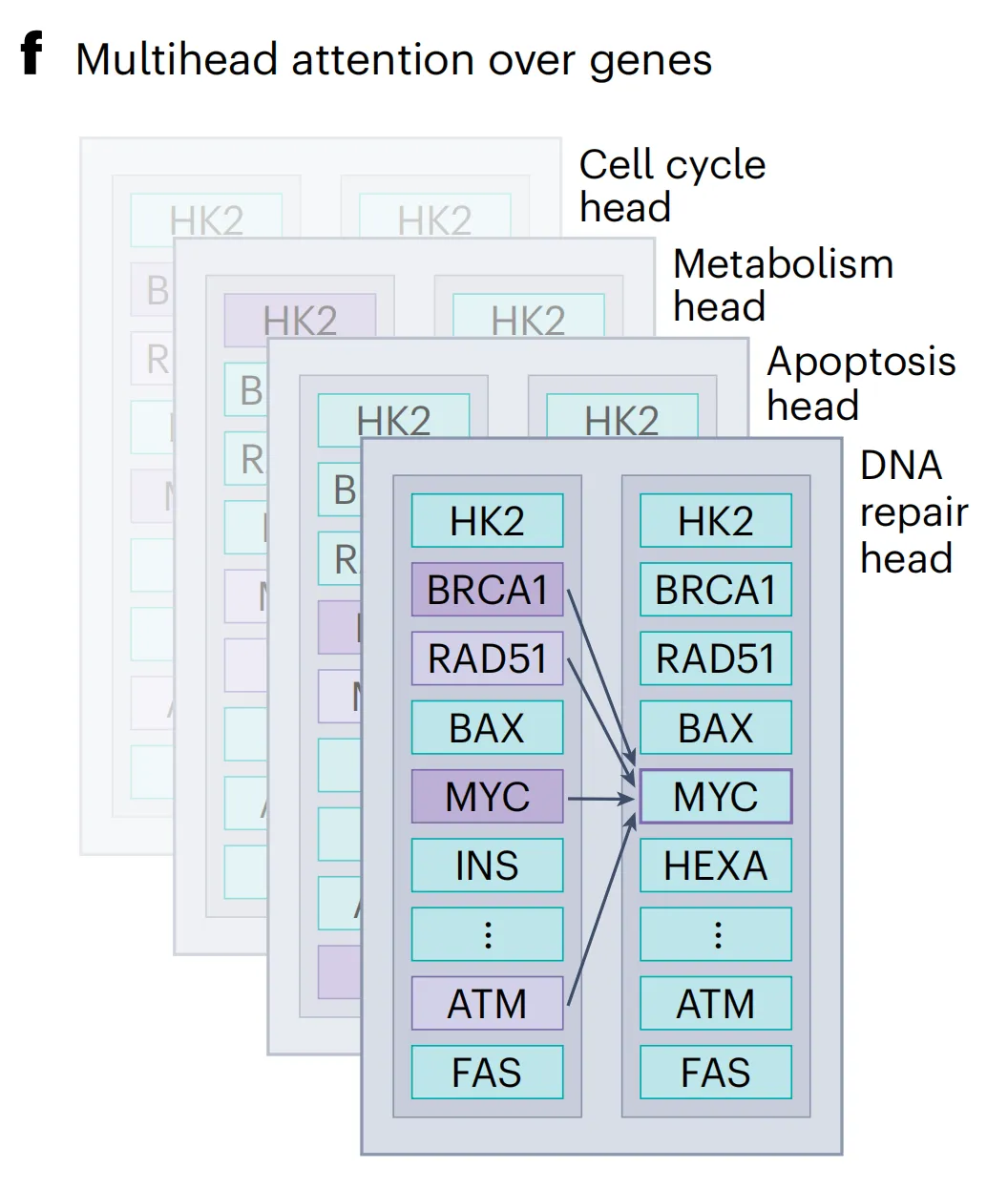

image-20241011112410699

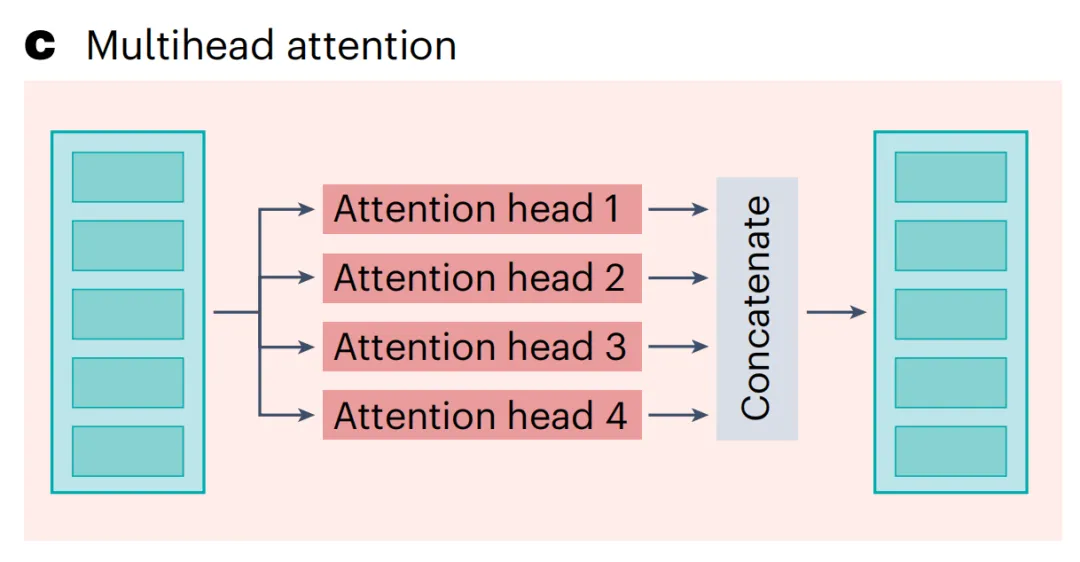

在单细胞组学中的变换器,其中输入嵌入对应于基因,这意味着对基因的注意力可能允许变换器捕获潜在的基因调控网络(GRN)。所谓的多头注意力允许每个注意力层捕获基因-基因关系的多方面特征;例如,每个注意力头可能捕获不同的细胞机制,如细胞周期、凋亡、代谢或DNA修复(图2f)。

image-20241011112435189

尽管在大多数当前的变换器中输入嵌入对应于基因17,20–22,24,但也有提出建模组织内细胞之间的相互作用,其中输入嵌入对应于细胞27,28。对细胞的注意力可能利用细胞的空间位置信息来编码细胞间关系并捕获细胞-细胞通信。尽管建模细胞群体的方面很有前景,但本综述主要关注单细胞内的以基因为中心的注意力,因为其普遍性和更确立的地位。

这里描述的注意力变体称为自注意力。注意力的输出是一个嵌入集合S'的变换,其中x'i的数量与S相同,且输出嵌入通常与xi具有相同的维度。

图2d展示了注意力的计算。

image-20241011112502830

x'i是S中所有输入元素xj的线性投影的加权和。重要的是,我们称为注意力分数的权重取决于S中的元素本身,并由注意力函数计算。为了简单起见,我们上面描述了所谓的单个注意力头,即具有一组可学习参数的注意力计算。变换器在多个变换器层中使用多头注意力(图2c)5。

image-20241011112521224

注意力函数的计算复杂度和内存需求随着输入嵌入数量的增加而二次方增长,这是由于它们的成对交互。当S中的输入元素数量很大时,例如,当输入嵌入对应于几千个以上的基因24时,这可能会成为问题。为了解决这个问题,已经开发出更有效的计算注意力的方法,如FlashAttention29、Performer30、稀疏注意力31和迭代注意力32。

注意力的有效计算和注意力近似以及一般的深度学习加速框架,如DeepSpeed33,仍然是研究和开发的活跃领域,从计算角度来看,这将可能允许未来模型在模型容量(模型参数的数量)和输入维度(例如,基因的数量)方面进行扩展。

最近的创新,如在Geneformer17中使用的DeepSpeed优化库,在scGPT20和Cell2Sentence23中使用的FlashAttention29的注意力有效计算,以及在scBERT24中使用的Performer30的注意力近似,都已经纳入了各种用于单细胞应用的变换器模型。

注意力分数的大小可以用来推断输入嵌入的相对重要性,通过本质上作为对值嵌入的加权因子。然而,每个层中的多个层和多个注意力头需要注意力分数的聚合(例如,求和),这降低了可解释性。注意力分数和特征重要性已被证明并不总是相关34,因此不一定可靠地识别负责输出的输入元素。

五、编码器与解码器

变换器最初被构想为编码器和解码器的结合体,其中变换器编码器和解码器由多个相同的层堆叠而成5。

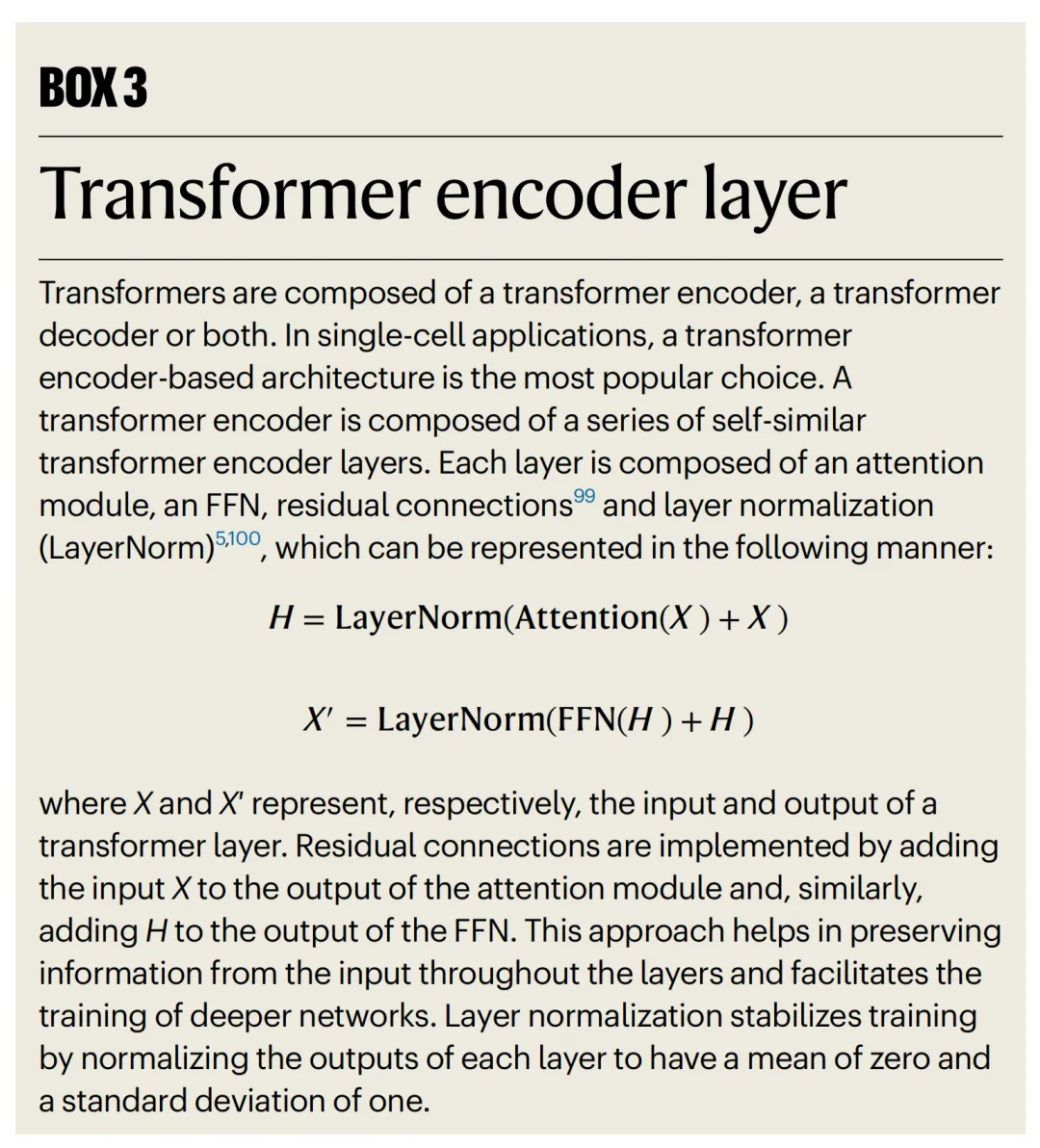

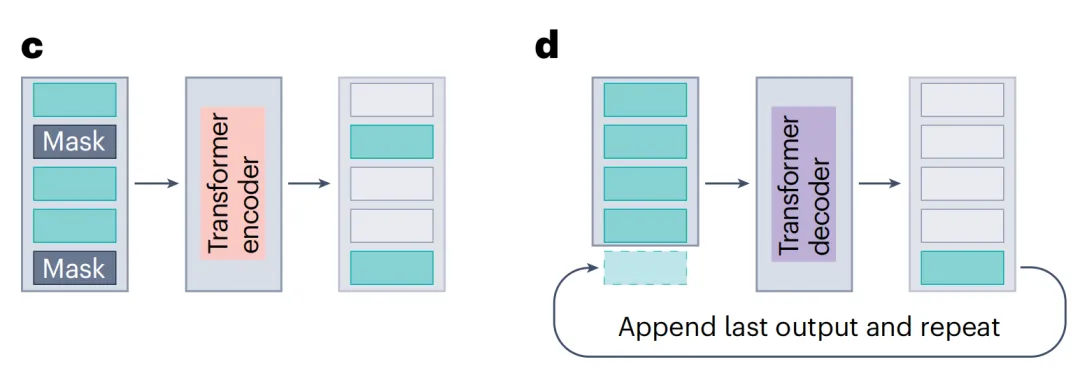

编码器(框3)处理输入数据并生成潜在表示,而解码器基于这些表示输出一个序列。

image-20241011112617051

编码器和解码器具有略微不同的架构,均基于多层注意力和FFN。解码器与编码器的区别仅在于注意力组件,使用遮蔽注意力和编码器-解码器注意力代替编码器的注意力。遮蔽注意力限制了注意力机制,使得每个输出只能受到序列中前一个元素的影响(图4c,d)。

image-20241011112641184

编码器注意力仅对输入序列操作,而编码器-解码器注意力允许解码器关注编码器的输出以及解码器自身的输入元素。这种机制使得解码器能够将其生成的输出与编码器产生的输入嵌入对齐。

迄今为止,大多数单细胞变换器依赖于仅编码器架构17,24,26,这使得遮蔽语言建模(MLM)成为可能,这是一种有效的预训练策略,下一节将详细说明。

tGPT22和scMulan35使用仅解码器模型,作为例外。仅解码器模型允许生成条件数据,例如,给定细胞类型、捐献者年龄或测序技术的转录组轮廓35,36。某些模型使用基于编码器或解码器的变换器层的变体。例如,scGPT20使用受解码器注意力遮蔽启发的定制遮蔽注意力,允许自回归生成。

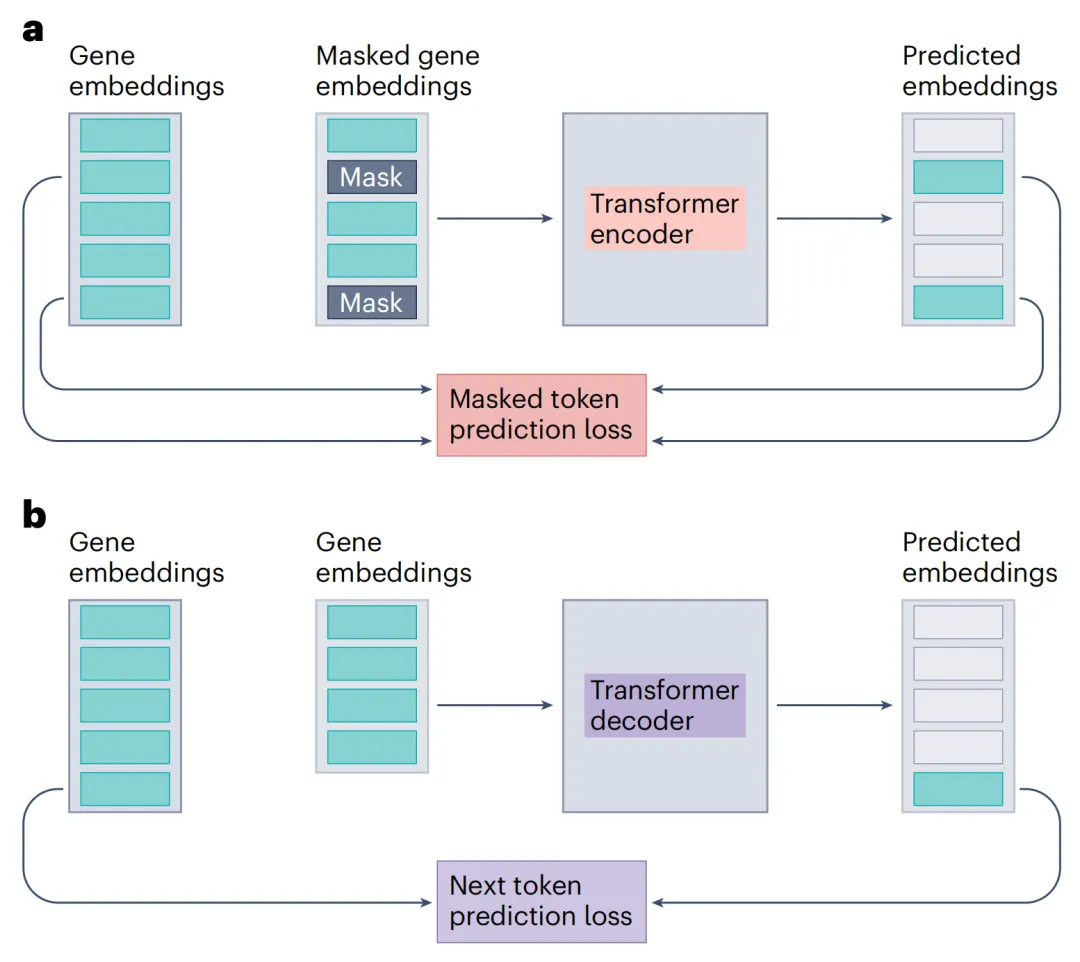

如果存在足够多的标注数据,变换器可以直接在感兴趣的 任务上进行训练。然而,尽管拥有数百万观察的单细胞数据集37很容易获取,但细胞标注通常有限且跨数据集不一致38。这使得自监督学习(SSL)作为实现遮蔽标记或下一标记预测(NTP)的单细胞建模变得吸引人,因为它依赖于数据中的内在结构而不是人类标注。

一种非常常见的自监督预训练策略称为MLM。MLM策略是将输入标记的部分替换为MASK标记嵌入,并从最终嵌入(变换器输出)预测被遮蔽的标记4。MLM被许多单细胞变换器所使用17,20,24,26,39,40。在变换器解码器和变换器编码器-解码器模型中使用的另一种预训练形式是NTP任务。该任务假设输入是一个序列,模型训练以预测给定前一个标记的下一个标记。

尽管一些模型在自监督预训练后表现出改进4,但其他模型即使在没有预训练的情况下也取得了最先进的结果8。同样,某些单细胞变换器利用SSL预训练17,20,24,如图4a,b所示,而其他模型仅通过监督方式在感兴趣的任务上进行训练25。

image-20241011112813846

此外,已经证明SSL预训练可能不会提高某些任务上的性能41。

六、单细胞变换器的应用

迄今为止,变换器已被应用于各种单细胞任务,如细胞标注、细胞和基因表示学习,以及针对特定条件或扰动下的单细胞模态预测17,20,36。

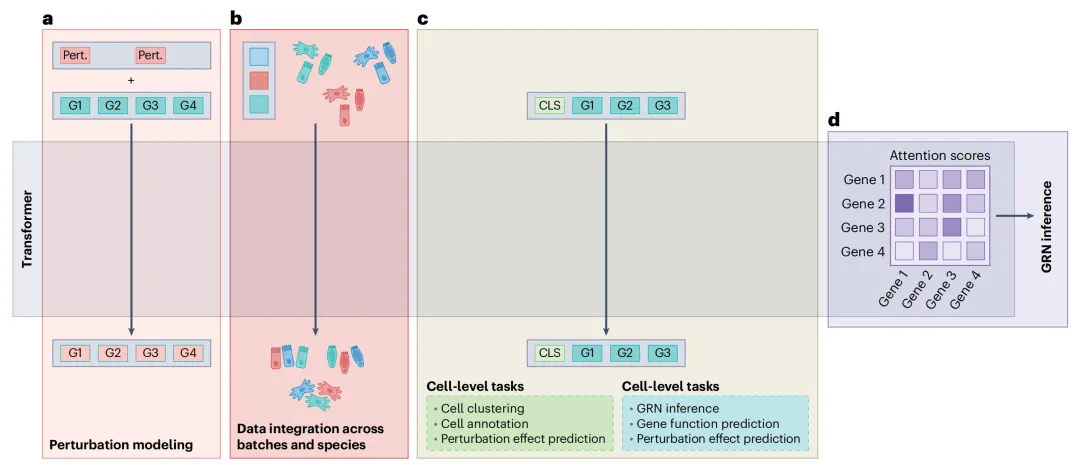

图5展示了单细胞RNA测序(scRNA-seq)变换器的应用案例。

image-20241011112846982

a部分,变换器可用于预测基因扰动的转录结果。一种模拟扰动的方法是向基因嵌入中添加一个可学习的嵌入,该嵌入指示基因扰动(标记为“Pert.”)20。G1–G4表示对应于特定基因的嵌入。模型输出的是由扰动改变的基因嵌入。

b部分,单细胞变换器已被用于整合跨研究、组织甚至物种的细胞分子轮廓26,55。这表明变换器在处理不同来源和类型的单细胞数据方面具有广泛的适用性。

c部分,CLS标记的输出可用于细胞级别的任务,而其余输出用于基因级别的任务20。这表明单细胞变换器能够同时处理不同层次的数据,从而为细胞和基因水平的分析提供信息。

d部分,注意力分数可能捕获细胞内的基因–基因关系,这可以用于推断基因调控网络(GRNs)20。注意力机制的这种应用揭示了单细胞变换器在理解细胞内复杂交互作用方面的潜力。

综上所述,图5展示了单细胞变换器在预测基因扰动效应、跨数据集整合、细胞和基因级别任务以及推断基因调控网络等不同领域的应用,突出了其在单细胞基因组学研究中的多功能性和潜力。

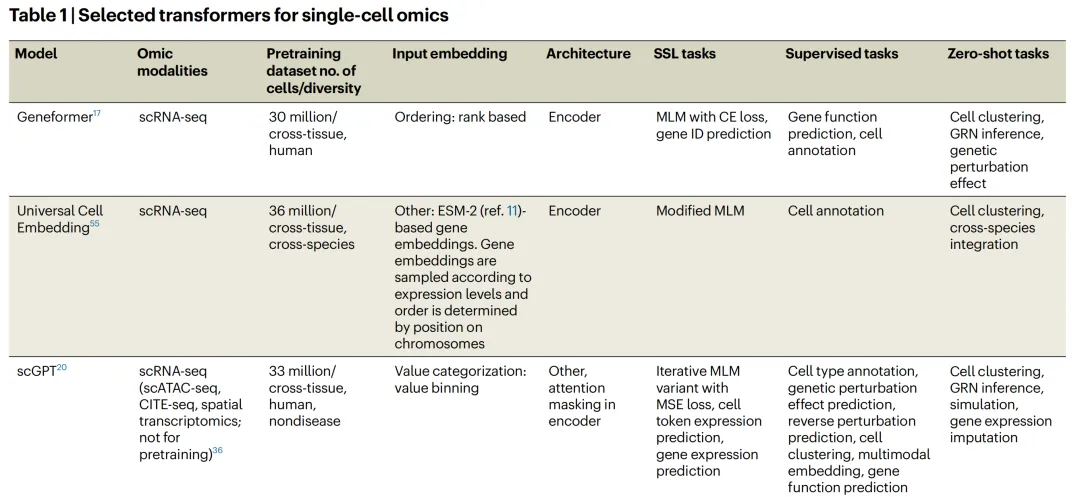

表1中提供了选定单细胞变换器及其应用的列表,并在https://github.com/theislab/single-cell-transformer-papers提供了一个全面且分类的扩展列表。

image-20241011113037318

虽然一些变换器是为单一任务开发的,例如细胞类型标注或跨模态预测25,42,但其他变换器尝试解决多种任务。希望经过足够多样化的数据训练(通常通过SSL)的模型能够获得关于细胞生物学的基础知识,从而能够在与细胞功能相关的广泛任务上表现良好。

技术上,解决不同任务是通过以零样本方式使用模型,或适应最终层并对模型进行微调以适应选定任务17,20来实现。

6-1:单细胞数据建模的挑战

建模单细胞数据面临几个主要挑战,需要加以考虑。这些挑战包括43:

噪声

单细胞数据受到不同技术因素的影响。例如,这些数据包含测序噪声,如dropout和细胞变异,这些噪声不能归因于自然发生的细胞状态,而是处理过程中技术效应的后果,如应激。

可以说,观察比典型单数据集模型更多的细胞可以改善基于变换器的模型对通用噪声特征的学习。一些变换器还试图通过用值分类预处理数据来提高信号质量20,24。

批次效应

不同实验、条件或实验室生成的数据可能存在系统差异,称为批次效应,这可能会混淆分析。一些变换器试图通过批次标记显式校正批次效应20,而其他变换器依赖于模型在接触异质数据集后更好地泛化的能力17。

稀疏性

许多单细胞读数,例如使用测序的单细胞可及染色质分析(scATAC-seq)和scRNA-seq44,具有高度稀疏性,大部分测量值为零。机器学习模型需要对此进行考虑,以有效避免过度计算。

许多单细胞变换器通过仅处理非零值17或按途径分组特征25来处理稀疏性。

6-2:基因表示

应用于单细胞数据的变换器通常将基因表达(或其他基因相关组学模态)编码为输入嵌入,从而产生基因级别的表示。这样的基因嵌入取决于其他基因在细胞中的表达所提供的环境,使其具有特定于上下文的特点。

通过在细胞内基因(或其他组学特征)之间应用注意力来实现上下文特异性17,20。上下文特定的嵌入可以用于各种任务,这些任务迄今为止依赖于固定的基因表示,例如,识别功能上相似的基因、基因功能预测以及在不同条件下基因功能变化的预测(例如,通过基因嵌入在模拟处理后变化的比较)17,20。

通过比较细胞间这种嵌入的相似性得分,上下文化的基因嵌入可以提供新的见解。例如,来自预训练的scGPT20的基因嵌入被用来构建相似性网络,这些网络将功能相关的基因分组,识别出已知的途径,包括一些在共表达网络中未揭示的途径。此外,对Geneformer17中的基因嵌入进行微调被证明在预测染色质状态和区分特定细胞类型中基因网络内的中心与外围因子方面是有效的。

由变换器生成的嵌入还可以用于通知依赖于预定义基因嵌入的其他模型26,39,45,如扰动响应预测模型GEARS46。同样,虽然目前大多数跨物种分析使用固定的基因直系同源信息(即跨物种匹配的基因标识符(ID)),但预定义的直系同源映射可能缺乏功能基因信息,仅依赖于蛋白质序列相似性,且与上下文无关47。

因此,多物种变换器26可能提供改进的特定于上下文的直系同源映射。

6-3:组学特征间的交互作用

组学特征涵盖了从各种“组学”领域研究获得的多样的数据,如基因组学、表观遗传学、转录组学、蛋白质组学和代谢组学。这些特征包括但不限于基因、转录本、蛋白质、代谢物和可及染色质区域。

组学特征间的交互作用对于理解细胞和生物体生物学至关重要。例如,配对的转录组学和染色质可及性分析被用于描述基因间的交互作用48,这对疾病预防具有重要意义49。

变换器通过组学特征间的注意力机制引入了一种新颖的方法来检查多模态交互作用,产生一个可学习的数据关系图。因此,细胞与组学特征标记之间的注意力分数可以用于识别细胞类型标记基因、与特定细胞表型相关的基因以及与生物过程相关的基因,如发育调节因子和与特定细胞表型相关的基因22,25,50。

同样,注意力可以用于预测组学特征间的交互作用,并识别中心基因——那些调节或被大量其他基因调节的基因17,51。例如,Geneformer17中的基因注意力分数集中于转录因子和中心基因,揭示了细胞调控机制。注意力值具有上下文特异性,因此结合ATAC-seq和RNA-seq数据可能揭示基于共结合转录因子表达和染色质可及性的特定上下文(例如,细胞状态特异性)基因调控。这种模型可解释性和生物见解发现的方法已在TOSICA25中探索。

TOSICA使用通路嵌入操作于通路注意力分数作为细胞表示,捕获细胞轨迹并将轨迹变化与特定通路或调节子联系起来,突出了推动疾病进展的调控网络。此外,scGPT20不仅使用基因注意力分数来推断基因调控网络(GRNs),还分析遗传扰动对这些网络的影响,展示了可以从单细胞变换器的注意力分数中提取的多种见解。

尽管这些成功,但注意力分数对于可解释性的实用性是微妙的。如前所述,变换器的注意力分数在某些情况下与特征重要性不相关34,这突显了在将其作为特征重要性归因工具的可靠性泛化时需要谨慎。

6-4:细胞表示

在低维空间中单个细胞的高质量表示是各种下游单细胞分析的关键组成部分52。其核心是保留生物变异,如细胞类型和细胞状态,同时最小化技术混淆,如批次效应,在数据集之间53。

然而,在整合来自多个研究、组织甚至生物体的数据时,区分不需要的批次效应和相关的协变量是具有挑战性的,并且常常依赖于上下文54。

变换器通过无批次意识的预训练提供了解决这一问题的有希望的方法,这种预训练已被证明对某些批次效应具有鲁棒性。例如,通用细胞嵌入(UCE)55和GeneCompass26已被用于跨研究、组织和物种大规模整合细胞的分子轮廓,使得UCE能够将细胞类型标注转移到模型未见过的物种数据上。

基于变换器的嵌入与其它技术有许多不同之处。

与基于变分自编码器(VAEs)56的流行模型如scVI13和scArches57或最近提出的SCimilarity14不同,后者显式学习低维嵌入,变换器通过常用的预训练任务本身并不产生低维细胞嵌入。

相反,细胞嵌入可以通过池化变换器对单个细胞的输出嵌入来实现,这可能对应于上下文化的基因嵌入17,45,或者通过引入一个特殊的细胞标记(CLS)到输入中,该标记在捕获细胞属性的任务上进行了训练20,25。

此外,尽管VAE-based模型通常通过将批次协变量与输入特征一起传递来显式学习批次协变量的影响13,一些变换器却被声称尽管没有显式使用批次协变量信息,但仍对批次依赖的技术伪迹具有鲁棒性17,26。此外,一些变换器还能够泛化到批量数据,产生有意义的批量嵌入22,39。变换器输入标记的灵活性促进了用于细胞表示的多模态特征的使用。

例如,scGPT20将跨组学层的单个特征视为单独的标记,从而实现了成对和马赛克集成20,并已被证明能够捕获其他最先进的多组学整合方法未能识别的免疫细胞亚群。

变换器细胞嵌入的其他应用包括通过分析扰动后细胞嵌入的变化来识别治疗靶点。例如,在Geneformer17中,来自肥厚型或扩张型心肌病患者的心肌细胞的细胞嵌入向对应于非衰竭心脏状态的嵌入的变化,表明抑制这些基因可能改善心肌细胞功能。

预测效果已通过实验验证,展示了单细胞变换器的实用性。

6-5:单细胞模态生成

变换器已被应用于基于预测单个细胞中基因表达或其他组学模态的各种任务。我们称这类任务为单细胞模态生成。这包括预测扰动下的基因表达,通过模拟单个输入基因的扰动(例如,敲除或敲减)或引入扰动条件(例如,细胞暴露于小分子)来实现17,20,58,59,提高读深度的预测39、数据填补36以及跨模态预测,后者使用已知的一个或多个模态来预测缺失的模态42,51。

例如,在一个任务中,给定对照细胞的状态作为输入,预测扰动细胞的表达谱,scGPT在Perturb-seq数据集的一个子集上进行了微调,其中特殊的标记指示哪些基因被扰动。该模型随后被展示能够准确预测对未见扰动的基因表达响应。

此外,生成性变换器可能直接模拟数据,例如,只需指定条件作为输入而无需任何组学特征36。一旦这样的模型被开发出来,它们可以用于在获取匹配对照组织具有挑战性的情况下,如涉及侵入性活检或第一阶段临床试验的研究中,进行扰动建模和预测对照数据集。

6-6:细胞注释

许多单细胞变换器是为单细胞注释任务而设计的,主要使用细胞的转录组学轮廓。注释的主要焦点是细胞类型预测,如scBERT24和TOSICA25模型仅专注于此任务。

通用单细胞变换器通常也会在细胞类型注释上进行评估17,20,26,40,并且自监督预训练通过在大型数据集上进行掩码输入建模已被证明可以提高其分类能力17,20。变换器显示出在未见数据集上泛化的令人鼓舞的能力36,这对于利用带有共识注释的参考数据集来注释新数据集至关重要。例如,TOSICA被展示即使在训练中未见的数据集上也能有效预测细胞类型,克服了批次效应25。

此外,UCE模型被用于将细胞类型注释转移到未见物种55。然而,非深度学习细胞类型预测器通常难以被超越。例如,在器官特异性细胞类型注释中,逻辑回归通常与更复杂的非线性预测器表现相当41,60,61。

在跨器官细胞类型注释中,一个非变换器模型,scTab,被展示在性能上超过了非深度学习最先进的细胞类型预测器和scGPT62。此外,尽管带有细胞类型注释的数据丰富便于在细胞类型注释任务上进行评估,但不同数据集之间的注释往往不一致,并且细胞类型注释的可靠性已受到质疑38。

因此,细胞类型注释任务可能不是衡量模型性能的可靠指标。

6-7:空间组学

变换器在空间组学应用方面也显示出前景27,28,36。

在本研究中,我们仅考虑直接应用于空间组学数据的模型,不包括那些处理病理切片图像的模型(PS:他们不考虑,我们研究病理的可以考虑,哈哈)。Nicheformer在空间邻域细胞密度预测和邻域组成预测方面取得了有希望的结果。

此外,它实现了空间与RNA测序分析之间的迁移学习,允许基于分离细胞的基因表达预测其空间背景63。scGPT36、SpaFormer28和CellPLM27在空间转录组基因表达填补任务上被证明是有效的,但只有SpaFormer和CellPLM同时处理多个细胞(而非基因)以建模细胞间关系。

这两个模型也是目前在模型输入中包含空间信息的唯一模型,通过位置编码来编码细胞的空间坐标。此外,CellPLM通过利用同一组织中相似细胞的表达进行单细胞RNA测序数据的去噪表现良好。空间转录组学领域的快速发展64,65以及变换器在其他领域解析空间坐标的能力7,使得这些技术的整合成为一个充满前景的新领域。

七、单细胞分析中的大型语言模型(LLMs)

除了在分子数据上训练的变换器之外,还有尝试使用在文本上训练的变换器,即大型语言模型(LLMs),来模拟单细胞数据。

我们在这里将LLM限定为模拟自然语言的上下文中,而有些来源则使用该术语来描述任何处理序列数据的变换器。一些方法直接使用语言模型,而其他方法则将分子数据编码为文本以进行进一步的微调。这种方法的动机来自于LLMs如GPT-4(参考文献66)的成功,据报道GPT-4能够在各种领域解决多样化和困难的任务67。

GPT-4在通用语言数据集上训练后,在细胞类型标注68和各种其他生物医学任务69上显示出前景,而无需特定任务的训练。此外,通用型LLMs的嵌入在包括批次整合、细胞类型分类和基因属性预测70在内的某些单细胞任务上被证明是有用的,这表明LLMs编码了一些单细胞知识。

早期的尝试通过将单细胞组学数据转换为文本后,在预训练的语言模型上进行微调来构建LLM的能力23。例如,Cell2Sentence23这样的将文本与转录组学数据结合的模型,通常将细胞的转录组轮廓表示为按表达水平排序的基因序列。

这并不不同于用于嵌入转录组数据的排序方法,但允许添加额外的文本细胞描述符。除了将文本与组学数据整合之外,一种在通用文本上预训练后,在生物医学文本、成像和基因组数据上训练的专门多模态变换器,在多个生物医学任务上的性能显著优于其通用型对应模型71。

这些结果展示了利用通用型语言模型作为专门单细胞模型基础的前景。然而,有效地将文本数据和以文本为中心的模型与显著不同于自然语言的单细胞组学数据融合的挑战仍然存在。

八、基础模型

“基础模型”是一个新近提出的术语,描述了一种在大型、多样化数据集上训练的人工智能(AI)系统,以学习无人类注释的模式6。

在大型未标注数据集上的训练使它们能够以远少于从头训练模型所需的数据量适应各种任务。变换器是基础模型的首选架构。一些例子包括自然语言变换器架构BERT4和GPT-4(参考文献66)、用于语音识别的Whisper8和用于图像识别的Vision Transformer7。

最近的工作探索了使用替代架构开发基础模型的可能性,包括图神经网络(GNNs)72,73。GNNs在模拟基因调控网络、分子结构和空间转录组学中的细胞间通信等应用74,75中显示出前景。然而,它们尚未展现出变换器在大型多样化数据集上所实现的可扩展性。

当实体间的关系未知时,如生物数据建模中常见的情况,变换器是合适的。虽然结合变换器和GNN优势的模型正在积极开发中,但变换器的灵活性和高效实现使其成为开发基础模型的主导架构6,72,73。

单细胞基础模型是一种在大量数据上训练的机器学习模型,可以有效适应与单细胞研究相关的广泛应用。

最近的一些单细胞模型在大数据集上进行了预训练,并声称是基础模型,包括基于自编码器的SCimilarity14和多个变换器20,26,39。GeneCompass26以其12层的变换器架构和超过1亿参数而引人注目,使用了迄今为止最大的预训练数据集,包含超过1亿2千万个单细胞转录组。

另一方面,UCE55在报道的参数数量上是迄今为止最大的单细胞变换器,拥有650百万参数,分布在33层中。与此相比,这些模型仍然远小于NLP模型。例如,PaLM有112层和大约5400亿参数76。

尽管单细胞变换器及其训练数据集的规模很大,但独立基准测试表明,当前的单细胞基础模型通常会被更简单、特定于任务的模型所超越,后者需要显著更少的训练数据和计算资源36,41,77。

九、当前限制与模型能力评估

尽管变换器在单细胞基因组学中的前景是明确的,但该领域目前尚处于初期阶段,面临一系列限制。例如,对于直接应用变换器所需的序列结构来源尚不明确。当前解决方案如将基因排序以将表格数据转换为序列17,21或沿着染色体位置对基因进行排序55可能只是初步的。

为了辨别变换器在单细胞组学中的附加值,进行严格评估是必要的。这将有助于回答多个方法学问题,如最佳数据编码、架构和训练程序是什么,以及评估变换器在超越现有方法的生物相关单细胞应用中的效用。

例如,尽管变换器可能在大数据集上训练,但关键是要确定基于非变换器的方法,在相似数据集上训练并使用相似计算资源时,是否会产生相似或更优的结果。因此,已经进行了多个变换器模型的基准测试36,41,77–79。

初步结果表明,尽管单细胞变换器可能在数据集之间具有泛化能力,但最先进的特定任务模型以及更简单的模型(如逻辑回归)通常在标注较少的任务上也能超越它们,且当前变换器的零样本性能存在疑问36,41,77。

值得注意的是,尽管SCimilarity14采用了自编码器架构,但在大型数据集上训练后,它在整合不同单细胞数据集方面显示出潜力。因此,变换器还不能被视为未来的首选方法。

尽管模型评估的重要性不言而喻,但现有基准测试的设计存在多个问题。

首先,一个常见的问题是竞争模型的评估不足。比较往往忽略了竞争模型的超参数调整,并且忽视了如XGBoost80和逻辑回归81等最先进的模型。所有可以利用预训练的模型都需要在相同的数据集上进行预训练。

其次,许多生物任务,如扰动效应预测,并没有普遍认可的指标和基准。第三,在大型和多样化数据集上的评估缺乏可能是评估声称具有广泛单细胞能力的模型性能的一个问题。

最近已经提出了一个用于细胞类型分类的大规模基准62。第四,数据集泄露,特别是在大型单细胞模型中,是一个需要关注的新兴问题。

具体来说,由于模型在预训练阶段利用了大型数据集,因此难以确保模型评估所使用的数据或其他高度相似的数据集之前没有被模型见过并记忆。最后,基准测试本身由于资源密集性和缺乏易于获取用于模型训练和评估的数据集、代码和模型权重而变得复杂。

除了直接模拟组学测量的模型外,生成语言模型在单细胞任务上的评估也提出了独特的挑战。

具体来说,由于这些模型在文本生成上的训练,它们的输出可能不符合期望的格式。此外,许多最先进的语言模型并不公开可用,且通过提供的接口获得的结果可能会随时间变化23,68。因此,对LLMs在单细胞任务上的评估需要特殊的适应。

目前,单细胞变换器的评估差异导致了混乱的局面。因此,该领域将受益于像其他领域常见的那样进行全面评估。一个透明的公开排行榜,对贡献开放,将进一步提高模型比较的可信度83。

十、结论与展望

以下是对未来话题的几点总结。

10-1:迈向细胞变异的多模态基础模型

正在进行的工作旨在构建人类和模式生物所有细胞的综合参考图谱84–86。

尽管单细胞数据的数量在增加,但跨不同研究、组织、条件和物种共同模拟细胞的问题仍未解决。目前,数据集整合的主要策略是为选定的感兴趣数据集创建低维、批次校正的细胞嵌入,通常局限于单个器官和物种,并依赖学习的表征进行下游分析87,88。

单细胞变换器提供了另一种方法——它们具有在多样化的数据集上预训练的能力,可能包括跨模态生成的所有单细胞组学数据。联合模拟组学数据,包括转录组学、表观遗传学、蛋白质组和细胞空间组织,可以使变换器通过整合每个组学模态提供的不同视角来准确编码细胞生物学。

一个多组学的细胞视角对于从基因组到表现型的分子层次的基本理解是必要的。例如,表观遗传学和转录组学的联合分析为DNA甲基化在细胞分化中的作用提供了新的见解89。尽管当前的单细胞变换器集成了多种模态,但它们仅使用除了scRNA-seq之外读数的小数量研究。

因此,开发大规模的多组学变换器仍然是未来研究的愿望20。多样的输入和预训练技术可以在不同的尺度上捕捉生物学现象,包括亚细胞、细胞和 组织水平,使变换器成为发展单细胞基础模型的可行架构。这样的多模态基础模型可能具有准确模拟细胞基因调控结构以及真正多尺度组织水平相互作用的能力。

然而,多模态基础模型在计算资源需求方面提出了重大挑战,因为引入更多模态可能需要更长的输入序列。为了减轻增加上下文长度带来的内存和计算需求,模型可能会采用稀疏数据表示技术,例如只考虑非零特征或将原始组学特征分组为有意义的单元,如通路。

在更广泛的机器学习社区中,正在进行的普遍讨论是未来是否会存在一个单一的多模态模型,广泛适用于所有领域和用例。这样的“通用基础模型”将链接所有类型的模态,包括文本、图像和音频,跨越领域——例如,一般对话、医疗诊断和科学实验——所有通过自然语言接口。

与此相对的是,基于大规模但特定领域的数据集训练的特定领域或模态的基础模型。最近的生物医学多模态基础模型提议90关注后者,并且第一个例子也出现在单细胞基因组学和其他许多领域91–93。

同时,细胞轮廓的文本表示23可能有助于发展跨越生物学、医学和化学等多个科学领域的通用文本基础模型。

10-2:模拟扰动景观

最近的细胞表示观点强调,除了使用细胞的分子特征快照来描述细胞外,捕捉细胞对扰动的响应的必要性58,94。

随着扰动数据集变得更加全面,我们期望未来的单细胞变换器将在丰富的扰动筛选上预训练,除了当前使用的组学快照,这将使我们更接近于对细胞状态和基因调控网络(GRNs)的整体理解94。

如果生成型变换器能够实现对单细胞数据的这种详细理解,它们可能成为通用的单细胞数据模拟器。这样的模型可用于为特定的细胞特征合成所需的细胞组学数据95。

10-3:结论

变换器在单细胞组学中的应用具有巨大潜力,但在彻底评估之前需要谨慎。目前尚不清楚变换器是否是非序列组学数据建模的正确架构,以及它们是否超越了该领域现有的方法。然而,与其他机器学习模型不同,变换器在大规模、多样化和未标注数据集上的预训练后,在广泛任务上展示了改进。

有效的自监督预训练使它们有可能从日益可用的大规模组学数据集中受益,并可能适用于广泛的数据和下游任务。尽管开发一个包含所有已知单细胞生物学的通用、基础变换器的愿望很吸引人,但这样的模型远未实现。尽管变换器在其他领域的多样化模态中取得了成功,但它们在模拟单细胞组学数据的应用仍然处于起步阶段。结合关于解释学习模型及其注意力分数的一般工作,跟踪这个快速发展的领域的发展将是一件令人兴奋的事情。

单细胞变换器论文的分类列表可以在 https://github.com/theislab/single-cell-transformer-papers 找到。